Stable Diffusionを使ったAI画像生成において、キャラクターの髪色は全体の印象を大きく左右する重要な要素です。黒髪から金髪、ピンクや青などのファンタジックな色まで、思い通りの髪色を表現するためには適切なプロンプト(呪文)の入力が欠かせません。しかし、単純に色名を入力するだけでは期待通りの結果が得られないことも多く、プロンプトの書き方にはコツがあります。また、生成後の画像修正や、グラデーションカラーなどの複雑な表現にも特別な技術が必要です。本記事では、Stable Diffusionで理想の髪色を実現するための具体的な方法から、トラブル対処法まで、初心者から上級者まで役立つ情報を詳しく解説していきます。

Stable Diffusionで髪色を指定する基本的な方法は?プロンプトの書き方を教えて

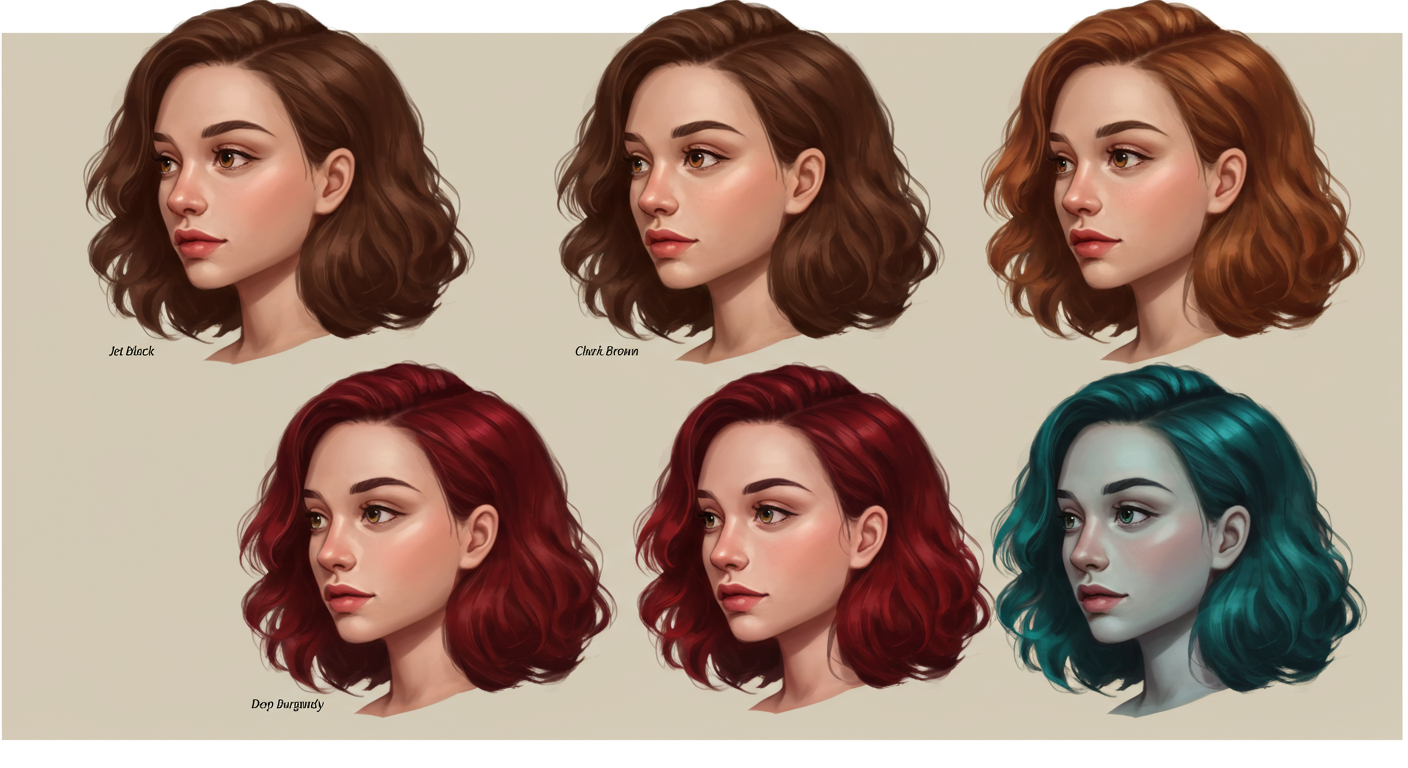

Stable Diffusionで髪色を指定する最も基本的な方法は、「色名 + hair」の形式でプロンプトに記述することです。例えば、黒髪なら「black hair」、金髪なら「blonde hair」といった具合です。

主要な髪色のプロンプト例を以下に示します。黒髪は「black hair」で知的で落ち着いた印象を与え、日本文化を象徴するスタイルとして人気です。茶髪には「brown hair」「chestnut brown hair」「caramel brown」など複数のバリエーションがあり、赤みのあるナチュラルブラウンから黄みのあるアッシュブラウンまで幅広く表現できます。

金髪系では「blonde hair」「platinum blonde hair」「golden blonde hair」「honey blonde」「champagne blonde hair」など、トーンによって細かく指定可能です。プラチナブロンドは白金に近く透明感が高く、「pearly highlights」を加えることで光を強調できます。シャンパンブロンドはベージュやピンクをほのかに含む上品な金髪を表現します。

赤髪は「red hair」「vibrant red hair」「burgundy hair」「copper hair」で鮮やかで情熱的な印象を、銀髪は「silver-gray hair」「metallic silver hair」で透明感と神秘性を演出できます。

ファンタジー系の髪色も豊富に表現可能です。青髪は「blue hair」「neon blue hair」「turquoise hair」で透明感と清涼感を、緑髪は「green hair」「emerald green hair」で自然との調和やミステリアスさを表現します。ピンク髪は「pastel pink hair」で優しく可愛らしい雰囲気を、紫髪は「purple hair」「light lavender hair」「violet hair」で神秘性と気品を与えます。

より詳細な髪色指定をする場合は、髪型、髪質、前髪の要素も組み合わせましょう。髪質には「Silky hair」(シルクのような細い髪)、「Straight hair」(ストレート)、「Wavy Hair」(ウェーブ)、「Curly hair」(カール)、「Messy hair」(ボサボサ)などがあります。前髪は「Short bangs above brows」(眉上)、「Blunt bangs」(パッツン)、「Swept bangs」(自然に流す)、「Hair over eyes」(目が隠れる長さ)などで指定できます。

プロンプトの配置も重要で、絶対に外せない要素(髪型や髪色など)は先頭に配置することで優先度を高められます。これにより、AIが最初に認識する要素として処理され、より確実に反映されやすくなります。

グラデーションカラーやメッシュなど複雑な髪色をStable Diffusionで生成するコツは?

Stable Diffusionでは単色だけでなく、グラデーションカラーやメッシュなどの複雑な髪色も表現できます。ただし、これらを成功させるには特別なプロンプト技術が必要です。

グラデーションカラーの基本的なプロンプト形式は以下の通りです:{頭頂部の色} hair, [(gradient hair from {毛先の色} to {頭頂部の色}: 1.4 ): 0.4 ], {その他の髪の特徴}

この仕組みは「全体的には頭頂部の色の髪だが、生成ステップの途中(例:40%以降)から毛先の色から頭頂部へのグラデーションをかけ始める」という指示になります。重要なポイントは、Stable Diffusionは毛先から色を認識し始めるため、色の順序を逆にしたい場合はプロンプトの順番も逆にする必要があることです。

具体的なグラデーション例として、黒から銀へのグラデーションなら「black hair, [(gradient hair from silver to black: 1.4 ): 0.4 ], short hair」となります。より複雑な三段階グラデーションの場合は「Triple gradient hair transitioning from teal at the roots, to neon pink in the middle, and pale gold at the tips」のように、「transitioning from ~ to ~」で順番を詳細に記述すると失敗が少なくなります。

ただし、色の組み合わせによってはグラデーションがうまく生成されない場合もあります。pink×green、pink×cyan、white×redの組み合わせでは失敗する可能性が高いと報告されているため、これらの組み合わせは避けるか、別のアプローチを検討しましょう。

ハイライトやメッシュの指定方法も多彩です。「((highlights hair, smoky purple streaked hair))」でパープルメッシュ、「((highlights hair, smoky rainbow streaked hair))」でレインボーメッシュ、「((highlights hair, Blue streaked hair))」で青色メッシュ、「((highlights hair, multicolored hair))」でマルチカラーメッシュが生成できます。

より上品なハイライト表現には、「Ash brown hair with subtle silver highlights」で控えめなシルバーハイライト、「Pastel pink hair with soft white highlights」で淡い白いハイライト、「Platinum blonde hair with pearly highlights」でパールのようなハイライトが可能です。

ただし、メッシュ系は「ガチャ要素が高くなる」(ランダム性が高くなる)傾向があるため、思い通りの結果が得られない場合は複数回生成を試すか、後述のInpaint機能での修正を検討しましょう。

生成済みの画像の髪色だけを変更したい場合、どうすればいい?Inpaint機能の使い方は?

生成済みの画像の髪型や髪色だけを変更したい場合は、Stable Diffusionにデフォルトで内蔵されているInpaint機能の利用が最も効果的です。Inpaintはインストール不要で、部分的な修正に特化した強力な機能です。

Inpaintの基本的な手順は以下の通りです:

- Stable Diffusionの「img2img」タブを開き、「Inpaint」をクリック

- 変更したい画像をドラッグ&ドロップし、変更する要素(髪型・髪色)を黒く塗りつぶします(マスクします)

- 変更したい要素(髪型・髪色)をプロンプト欄に入力

- 最後に「Generate」をクリックして生成

Inpaintには2つの修正パターンがあり、用途に応じて使い分けることが重要です。

Whole Picture(ホールピクチャー)は、マスクした部分と同時に画像全体を再生成するため、全体と部分の整合性が高く、画素数も均一です。色ムラが少なく、低画質の画像を編集する場合に推奨されます。一方で、全体を再生成するため処理時間が長くなる傾向があります。

Only Mask(オンリーマスク)は、マスクした部分だけを画像生成するため、修正箇所だけを非常に高い画素数で生成できます。表向き512×768で修正した場合でも、2K画像に対応できるほどの画素数になり、Whole Pictureの約2倍の解像度を実現します。アップスケールした高画質な画像を修正する場合に最適で、2K画像で800×800、4K画像で1400×1400程度の画素数で問題なく修正でき、高速処理が可能です。

Inpaint使用時の重要な設定とコツをご紹介します。まずプロンプトの入力については、元画像を生成した際のプロンプトをそのまま使用するとAIが混乱することがあります。修正時は、全体の品質プロンプト(例:「masterpiece」「best quality」「photography」)と作風に関するプロンプト(例:「photo realistic」)を残し、それ以外の元プロンプトは全て消去することが推奨されます。

Denoising Strength(デノイズ強度)は画像の変化の度合いをコントロールする重要な設定です。0から1の範囲で調整し、推奨される開始値は0.6です。低い値(0-0.2)ではほぼ元画像に近い結果、中程度の値(0.3-0.4)ではわずかな変化、高めの値(0.5-0.6)では形や色を変化させやすく最もコントロールしやすいゾーンとされています。

Mask blur(マスクブラー)はマスクした範囲の境界線をぼかして馴染ませる機能で、基本的には値4で十分です。ペイントの際は、一筆書きで塗らないことが重要で、塗り間違えた時に一気に消えるのを防ぐため、ある程度のところで一度ペンを離しましょう。

Stable Diffusionで髪色指定がうまくいかない時の原因と対処法は?

Stable Diffusionで髪色指定がうまくいかない主な原因と、それぞれの効果的な対処法について解説します。

最も頻繁に発生する問題の一つが「カラーリーク」です。これは髪色を指定した際に、その色がバッグや髪飾りなど他の要素にも反映されてしまう現象です。例えば、赤髪を指定したのに、服やアクセサリーまで赤くなってしまうケースがこれに該当します。

カラーリークの対処法として、まず他の要素にも色の指定をすることが効果的です。「red hair, black bag, white flower hair accessory」のように、他の要素の色も具体的に指定します。また、プロンプトの位置を変更することも有効で、重要な要素はプロンプトの先頭に配置するという原則を活用し、色の指定を調整しましょう。

モデルとの相性問題も見逃せません。特定の髪型(例:アフロやドレッドヘアー)をアジア系のリアルな画像出力が得意なモデルに指定しても、思い通りの画像が生成されないことがあります。これは、モデルが学習したベース画像にそのような髪型が含まれていないためです。この場合の対処法として、LoRA(Low-Rank Adaptation)の活用が有効です。

LoRAは特定のスタイルや要素を正確に表現するための追加学習データで、CivitAIのようなプラットフォームには髪に関する様々なLoRAモデルが公開されています。例えば「LORA:concept Colored inner hair」「LORA:Half Color Hair」「LORA:Split-Color Hair (Black & White)」「LORA:Rainbow Hair」などがあり、これらを使用することで、ド派手な髪色や手の込んだ奇抜な髪型も再現しやすくなります。

プロンプトの質を向上させることも重要な対処法です。詳細な記述でメインの被写体とシーンを明確かつ簡潔に記述し、修飾語と属性でキャラクターの外見、設定、気分などの属性を追加することで、ディテールを向上させます。また、解像度と品質タグとして「8K resolution」「high detail」「HDR」「UHD」「highly detailed」「studio lighting」「vivid colors」「bokeh」などの用語を使用することで、画像の品質を大幅に向上させることができます。

トークン効率の問題も考慮すべきです。プロンプトは実質的に75トークンに制限されているため、プロンプトが長くなる場合は、意味に大きく寄与しない単語を効率化することが重要です。例えば「A horse in the style of Vincent Van Gogh」(11トークン)よりも「Horse Van Gogh」(5トークン)の方が効率的です。

最後に、画像編集ソフトでの追加補正も有効な対処法です。生成後にトーンカーブで光と影のバランスやコントラストを調整したり、色相・彩度スライダーで全体の色味を変更したり、ブラシツールでハイライトや影を描き足したりすることで、微調整が可能です。

Stable Diffusionで髪色生成をする際に知っておくべき便利なツールや設定は?

Stable Diffusionで髪色生成の品質を向上させるために知っておくべき便利なツールと重要な設定について詳しく解説します。

主要なオンラインプラットフォームとして、まずOpenArtがあります。これは無料でAI画像を生成できるオンラインプラットフォームで、数百万枚のAI生成画像とプロンプトを発見でき、画像コンテンツによる検索も可能です。AIアートのポートフォリオを作成し、コミュニティで作品を公開できるほか、Stable DiffusionとDALL-E 2を無料で利用できます。

Conoha AI Canvasは、Stable Diffusion XLを利用できるAIイラスト生成ツールです。インストール不要でプログラミングの知識も不要なため、誰でも簡単に高品質な画像を生成できます。高性能PCが不要で、ブラウザ操作だけで完結し、日本語サポートとマニュアルが充実しており、月額990円からというリーズナブルな料金で利用可能です。

CivitAIは、Stable DiffusionモデルやLoRAなどの追加学習データが公開されているサイトで、様々な髪の毛関連のLoRAが提供されています。「hair」と検索すると多くのLoRAが見つかり、特殊な髪色や髪型の実現に役立ちます。

重要なパラメータ設定について詳しく説明します。Classifier Free Guidance(CFG)スケールは「創造性 vs. プロンプト」の尺度として機能します。低い値(2~6)ではAIに創造性を与えますがプロンプトに忠実でない場合があり、中程度の値(7~10)はほとんどのプロンプトに推奨され、創造性と指示への忠実さのバランスが良いとされています。高めの値(10~15)はプロンプトが十分詳細である場合に推奨され、複数の被写体が登場するプロンプトではCFGスケールを上げると良い結果が得られることがあります。

Step count(ステップ数)は、Stable Diffusionが画像を生成する際のノイズ除去ステップ数です。通常は数が多いほど良いですが、初心者にはデフォルトの50が推奨されます。ステップ数を増やすと生成時間が増加しますが、VRAMには影響しません。

Sampler(サンプラー)は画像をデノイズする方法を決定します。DDIMサンプラーは高速で、10ステップで良い画像を生成できるため、初心者におすすめです。

品質向上のための特殊プロンプトも活用しましょう。「cinematic lighting」や「vibrant colors」などのキーワードを使って、目的のライティングや色効果を実現できます。「studio lighting」は画像に素晴らしいテクスチャを加え、「vivid colors」は画像に活気を生み、「bokeh」は背景をぼかし被写体を際立たせる効果があります。

試行錯誤と実験も重要な要素です。異なるキーワードやフレーズを試すことで、画像への影響を理解し、最終的な結果を洗練させることができます。Stable Diffusionは多様な髪色や髪型を表現する強力なツールですが、ユーザーの創造力と、これらの技術的知識を組み合わせることで、無限の表現の可能性が広がります。

コメント