画像生成AIの革命とも言えるStable Diffusionは、2025年現在、多くのクリエイターや技術者にとって必須のツールとなっています。オンラインサービスも便利ですが、ローカル環境での構築こそが真の可能性を引き出す鍵となります。無制限の画像生成、完全なプライバシー保護、そして自由なカスタマイズ性を手に入れることができるからです。しかし、高スペックなハードウェアと技術的な知識が必要という課題もあります。本記事では、2025年最新の情報をもとに、Stable Diffusionローカル環境構築の疑問にお答えしていきます。初心者の方でも安心して取り組めるよう、具体的な手順からトラブル対処まで詳しく解説いたします。

Stable Diffusionをローカル環境で構築するメリット・デメリットとは?

Stable Diffusionのローカル環境構築を検討する際、まず理解すべきはその圧倒的なメリットと現実的な課題です。

最大のメリットは完全な自由度にあります。一度環境を構築すれば、生成画像数に制限がなく、オフラインでも無制限に利用可能です。オンラインサービスでは月額料金や生成枚数制限がありますが、ローカル環境なら電気代のみで済みます。また、商用利用の制限もなく、生成した画像を自由にビジネスに活用できます。

プライバシー面での安心感も大きな利点です。生成した画像は完全にローカルに保存され、外部サービスにアップロードされることがありません。機密性の高いプロジェクトや個人的な創作活動において、この点は非常に重要です。さらに、インターネット接続が不安定な環境でも安定して利用可能で、災害時やオフライン環境でも作業を続けられます。

技術面では、カスタムモデルやプラグインを自由に導入でき、細かな設定調整も思いのままです。LoRAやControlNetなどの高度な機能を組み合わせることで、オンラインサービスでは実現できない精密な画像制御が可能になります。

一方で、デメリットも無視できません。最大の課題は高スペックGPU搭載PCが必要という点です。NVIDIA GPU(VRAM 6GB以上推奨)が必須で、理想的にはRTX 3060以上(VRAM 8GB以上)が求められます。この初期投資は決して安くありません。

技術的な知識と時間投資も必要です。初期設定が複雑で、Python、Git、各種ライブラリの理解が求められます。また、モデルファイルのダウンロードに大容量のストレージ(100GB以上推奨)が必要で、トラブルが発生した際の対処も自分で行わなければなりません。

メンテナンスコストも考慮すべき点です。定期的なソフトウェアアップデート、モデルファイルの管理、GPU温度監視など、継続的な管理作業が発生します。しかし、これらの課題を乗り越えた先には、無限の創造可能性が待っています。

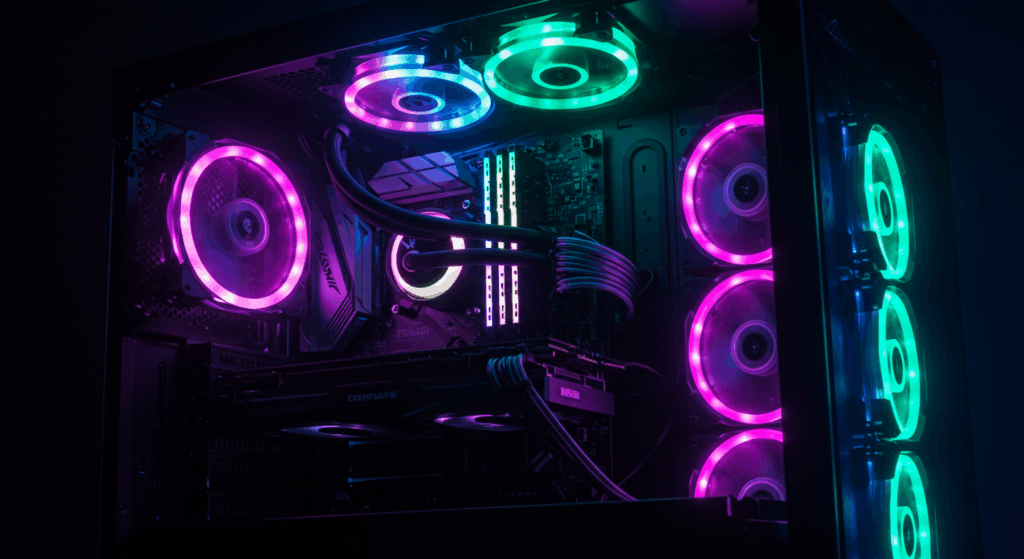

2025年版Stable Diffusionローカル環境に必要なPCスペックと推奨構成は?

2025年現在のStable Diffusion環境構築において、適切なハードウェア選定は成功の鍵となります。

最小要件から見ていきましょう。OSはWindows 10/11(64bit)が基本で、GPU はNVIDIA製でVRAM 4GB以上が必須です。RAMは16GB以上、ストレージは50GB以上の空き容量が必要です。また、Python 3.10.6とGitのインストールも前提条件となります。ただし、これは「動作する」レベルであり、快適な作業には不十分です。

推奨構成では大幅にスペックアップが求められます。GPU はNVIDIA RTX 3060以上(VRAM 8GB以上)を強く推奨します。2025年中旬時点で主流のSDXLでは約6GBのモデルデータが必要で、複数モデルの同時利用や高解像度生成を考慮すると、8GB以上は必須です。可能であればRTX 4070以上(VRAM 12GB)を選択すると、より快適な作業環境が構築できます。

RAMは32GB以上が理想的です。大容量モデルの読み込みや複数のブラウザタブ、画像編集ソフトの同時使用を考慮すると、16GBでは不足する場面が多くなります。特にControlNetやMultiple LoRA使用時は、メモリ使用量が急激に増加します。

ストレージ構成も重要なポイントです。システム用とは別に、モデル専用のSSDを100GB以上確保することを推奨します。SDXLモデルは5-7GB、LoRAは50-200MB、ControlNetモデルは1-3GBと、複数導入すれば容量は急激に増加します。読み込み速度の観点から、HDDではなくNVMe SSDの使用が望ましいです。

2025年の最新トレンドとしては、RTX 40シリーズの普及が挙げられます。RTX 4060(VRAM 8GB)は価格と性能のバランスが良く、入門者におすすめです。RTX 4070 Super(VRAM 12GB)以上なら、ほぼすべての用途で快適に利用できます。

CPUについては、GPU重視のため相対的に重要度は下がりますが、Intel Core i5-12400以上、またはAMD Ryzen 5 5600X以上を選択すると安心です。特にComfyUIのような複雑なワークフローでは、CPUパフォーマンスも影響します。

電源容量の計算も忘れてはいけません。RTX 4070なら650W以上、RTX 4080以上なら750W以上の電源ユニットが必要です。80PLUS Gold認証以上の高効率電源を選択することで、電気代と発熱を抑えられます。

ノートPCでの利用も2025年現在では現実的になってきました。RTX 4060 Laptop(VRAM 8GB)搭載モデルなら、外出先でもある程度の画像生成が可能です。ただし、熱管理と電源確保が課題となるため、長時間の作業にはデスクトップPCが適しています。

初心者におすすめのWebUI(AUTOMATIC1111・Forge・ComfyUI・Fooocus)の選び方は?

2025年現在、Stable Diffusion用WebUIは多様化し、それぞれ異なる特徴と適用場面を持っています。初心者の方が最適な選択をするためのガイドをご紹介します。

AUTOMATIC1111 Web UI(A1111)は依然として最も人気の高い選択肢です。直感的な階層UIデザインで、WindowsやMacに慣れた方なら違和感なく操作できます。パネルやタブに整理された機能が分かりやすく、初心者にも扱いやすい構成となっています。Stable Diffusionの主要機能を網羅しており、標準機能で不足を感じることは少ないでしょう。豊富な拡張機能エコシステムも魅力で、Additional Networks、Dynamic Prompts、Regional Prompter、Adetailerなど、多彩な機能を後から追加できます。まず始めるなら間違いのない選択です。

WebUI Forgeは「A1111の進化版」として注目を集めています。省エネ・高速・高解像度生成を目的として設計されており、同じハードウェアでもより高速な画像生成とVRAM使用量の削減を実現します。低スペックGPUでも高品質な画像生成が可能になるのは大きなメリットです。ControlNetとStable Video Diffusionがデフォルトで利用可能で、別途インストールする手間も省けます。A1111に慣れた方のステップアップ先として最適です。

ComfyUIはノードベースのGUIを採用した上級者向けツールです。各プロセスをノードとして管理し、視覚的にワークフローを構築できます。カスタマイズ性が非常に高く、異なるブロック(ノード)を連結することで、複雑な画像生成パイプラインを構築できます。Smart Memory Managementにより、わずか1GBのVRAMでの動作も可能です。ただし、学習コストが高く、初心者には敷居が高い面があります。プログラミング経験者や、ワークフローの自動化を求める方に適しています。

FoocusはシンプルさのZen(禅)を体現したWebUIです。MidJourneyの簡潔なアプローチにインスパイアされ、プロンプト入力と結果表示に特化しています。複雑な設定を排除し、ユーザーが「望む画像の作成により多くの時間を費やせる」ことを目指しています。初心者が「とにかく簡単に始めたい」場合の最適解です。ただし、現在は限定的な長期サポート(LTS)状態で、新機能追加は期待できません。

用途別推奨選択としては、以下のように整理できます。完全な初心者で学習時間を確保できる方:AUTOMATIC1111。豊富な情報と拡張機能で、長期的な成長が見込めます。既にA1111を使用していてパフォーマンス向上を求める方:WebUI Forge。互換性を保ちながら高速化を実現できます。

とにかく簡単に始めたい方:Fooocus。設定の複雑さに悩まされることなく、すぐに画像生成を楽しめます。技術者やエンタープライズ用途:ComfyUI。高度なカスタマイズと自動化が可能で、大規模プロジェクトに適しています。

2025年の推奨開始戦略は、FoocusでStable Diffusionの基本を理解した後、AUTOMATIC1111またはWebUI Forgeに移行するパターンです。ComfyUIは、他のWebUIで物足りなさを感じた段階での選択肢として考えると良いでしょう。どのWebUIを選択しても、豊富なモデルとコミュニティサポートにより、創造的な画像生成を楽しむことができます。

Stable Diffusionローカル環境でのモデル管理と高品質生成のコツは?

ローカル環境でのStable Diffusion活用において、適切なモデル選択と管理は画像品質を左右する最重要要素です。

モデルの基本分類から理解しましょう。SD 1.5は軽量で高速、豊富なカスタムモデルが利用可能で、低スペック環境でも安定動作します。SDXLは高解像度生成が可能で、2025年現在の主流となっています。約6GBのモデルサイズですが、簡潔なプロンプトでも高品質な画像を生成しやすいのが特徴です。SD3は最新版ですが、商用利用には制限があるため注意が必要です。

2025年推奨モデル選択では、用途に応じて最適なものを選ぶことが重要です。アニメ・イラスト系ならNoobAI-XLが最有力候補です。複雑なポーズや手足の描写が得意で、他モデルと比較して細かい描写が優秀です。Animagine XL V4.0は継続的改良により品質向上しており、V3系からの進化が顕著です。日本人美女生成にはfuduki_mixが定番で、日本人特有の顔立ちや肌質を高精度で再現できます。

リアル系では、Realistic Visionが写真品質の人物画像生成に優れ、DreamShaper XLは多様なシチュエーションに対応する汎用性を持ちます。初心者にはバランス型のDreamShaper V8から始めることを推奨します。

ファイル配置の正確性も重要です。Checkpointモデルはmodels/Stable-diffusion/フォルダ、VAEはmodels/VAE/、ControlNetはmodels/ControlNet/、LoRAはmodels/Lora/に配置します。ファイルパスに日本語が含まれるとエラーの原因となるため、英数字のみのフォルダ名を使用してください。

LoRA(Low-Rank Adaptation)の活用は2025年のカスタマイズ中核技術です。ファイルサイズが2-200MBと管理しやすく、複数の同時適用も可能です。プロンプトには<lora:モデル名:0.8>の形式で記述し、数値(0-1)で影響の強さを調整できます。CivitaiとHugging Faceが主要な入手先です。

高品質生成のプロンプト戦略では、効果的な要素組み合わせが鍵となります。メインサブジェクト(主題)→スタイル指定→構図指定→照明条件→品質強化ワードの順序で構築します。品質強化には「masterpiece, high quality, detailed, 8k resolution」などを使用し、ネガティブプロンプトで不要要素を除外します。定番のネガティブプロンプトは「(worst quality, low quality:1.4), blurry, bad anatomy, bad hands, extra fingers」などです。

生成パラメータの最適化も重要なポイントです。サンプラーはDPM++ 2M Karrasが推奨、ステップ数は20-30、CFGスケールは7-12に設定します。解像度はSDXLなら1024×1024、SD1.5なら512×768が標準です。–xformersオプションの有効化により、メモリ使用量削減と高速化を実現できます。

効率的なワークフロー構築では、段階的なアプローチが効果的です。まず低解像度(512×512)でコンセプト確認を行い、プロンプトとパラメータを調整した後、高解像度での最終生成に進みます。必要に応じてReal-ESRGANなどでアップスケーリングを実行します。

モデル管理のベストプラクティスとして、定期的なファイル整理、不要モデルの削除、バックアップの作成を心がけましょう。特に商用利用時は、各モデルのライセンス情報を詳細に記録することが重要です。

ローカル環境でのトラブルシューティングとパフォーマンス最適化方法は?

Stable Diffusionローカル環境では、適切なトラブル対処とパフォーマンス調整が快適な作業環境の鍵となります。

最も頻発する「CUDA out of memory」エラーへの対処から始めましょう。このエラーはVRAM不足が原因で発生します。即座の対処として、バッチサイズを1に設定、解像度を下げる(1024×1024→768×768)、複数モデルの同時使用を避けることが効果的です。根本的解決には--lowvramまたは--medvramオプションを起動引数に追加します。ただし、生成速度は低下するトレードオフがあります。

モデル読み込みエラーも頻繁に遭遇する問題です。ファイルパスに日本語が含まれていないか確認することが最優先です。日本語フォルダ名はPythonで処理できない場合があります。また、モデルファイルの破損も原因となるため、再ダウンロードを試してください。権限設定の問題では、管理者権限でWebUIを実行することで解決する場合があります。

生成速度の異常な低下には複数の原因があります。GPUが正しく認識されているか確認し、タスクマネージャーでGPU使用率をチェックしてください。0%の場合、CPUモードで動作している可能性があります。CUDAドライバーの更新、PyTorchの再インストールも効果的な対処法です。コマンドプロンプトでnvidia-smiを実行し、GPU情報が正しく表示されるか確認しましょう。

パフォーマンス最適化の基本戦略では、適切なサンプラー選択が重要です。DPM++ 2M Karrasは品質と速度のバランスが優秀で、多くの場面で推奨されます。Euler aは高速だが品質がやや劣り、DDIMは高品質だが時間がかかります。ステップ数は20-30で十分な品質が得られ、それ以上は時間対効果が悪化します。

VRAM使用量最適化テクニックとして、xformersの有効化(--xformersオプション)は必須です。メモリ使用量を30-50%削減できます。VAEのオフロード(--lowvram)やモデル分割(--medvram)も有効ですが、速度とのトレードオフを考慮してください。

システムレベルでの最適化も見逃せません。仮想メモリの設定を物理メモリの1.5-2倍に増やし、不要なバックグラウンドアプリケーションを終了します。Google Chrome等のブラウザは大量のメモリを消費するため、生成中は最小限に抑えましょう。

GPU温度管理は安定動作の基盤です。MSI Afterburnerなどでモニタリングし、80度以下を維持してください。適切なファンカーブ設定で冷却を強化し、ケース内エアフローを改善します。定期的な清掃でホコリを除去することも重要です。

定期メンテナンス手順として、月次でのモデルファイル整理、不要な一時ファイルの削除、拡張機能のアップデート確認を推奨します。特にoutputsフォルダは急速に肥大化するため、定期的なバックアップと古いファイルの削除が必要です。

エラーログの活用も重要なスキルです。コンソール出力のPythonエラーメッセージを読み解くことで、問題の根本原因を特定できます。RuntimeError、FileNotFoundError、ImportErrorなど、エラーの種類に応じて対処法が異なります。GitHub Issuesでの情報収集やDiscord/Redditコミュニティでの質問も有効な解決手段です。

バックアップ戦略も忘れてはいけません。設定ファイルのバックアップ、カスタムモデルのバックアップ、重要な生成画像の外部保存を定期的に実行し、システム障害時の復旧に備えましょう。

コメント